GLM简介

在 ChatGPT 的核心团队中,不乏清华大学毕业进入 OpenAI 的开发者,就在 GPT-4 发布的同一天,清华大学顶尖的 NLP 团队,也公开了自研的类 ChatGPT 的大模型 —— 中英双语对话模型 ChatGLM-6B,初具问答和对话功能,现已开启邀请制内测(内测申请网址 http://chatglm.cn),后续还会逐步扩大内测范围。

模型缺陷

由于ChatGLM-6B的规模较小,目前已知其具有相当多的局限性,如事实性/数学逻辑错误,可能生成有害/有偏见内容,较弱的上下文能力,自我认知混乱,以及对英文指示生成与中文指示完全矛盾的内容。

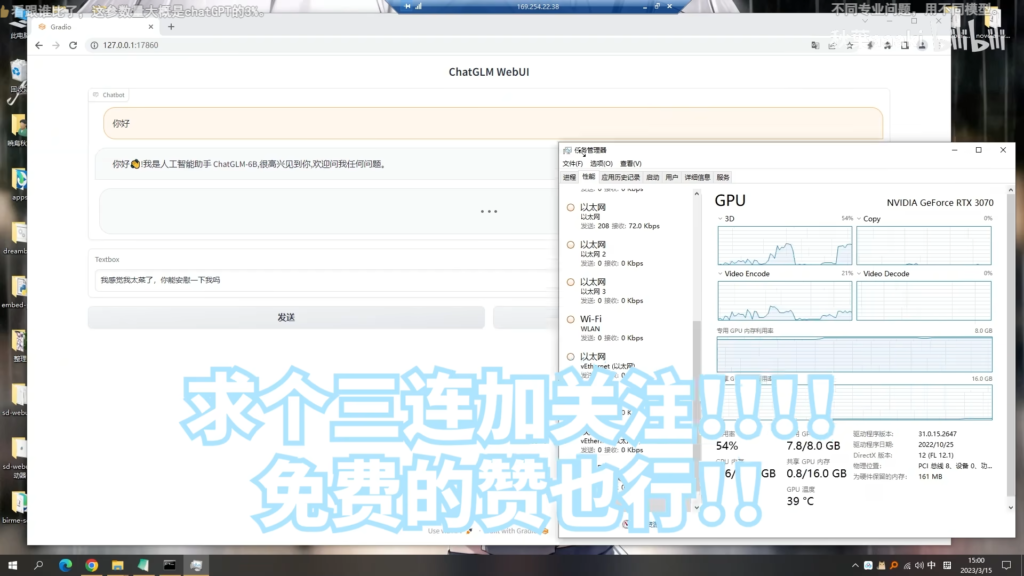

本地部署教程

资源下载

模型可以从huggingface上下载 https://huggingface.co/THUDM/chatglm-6b

webui项目地址,目前只是简易版仍然在更新

ChatGLM-webui:https://github.com/Akegarasu/ChatGLM-webui