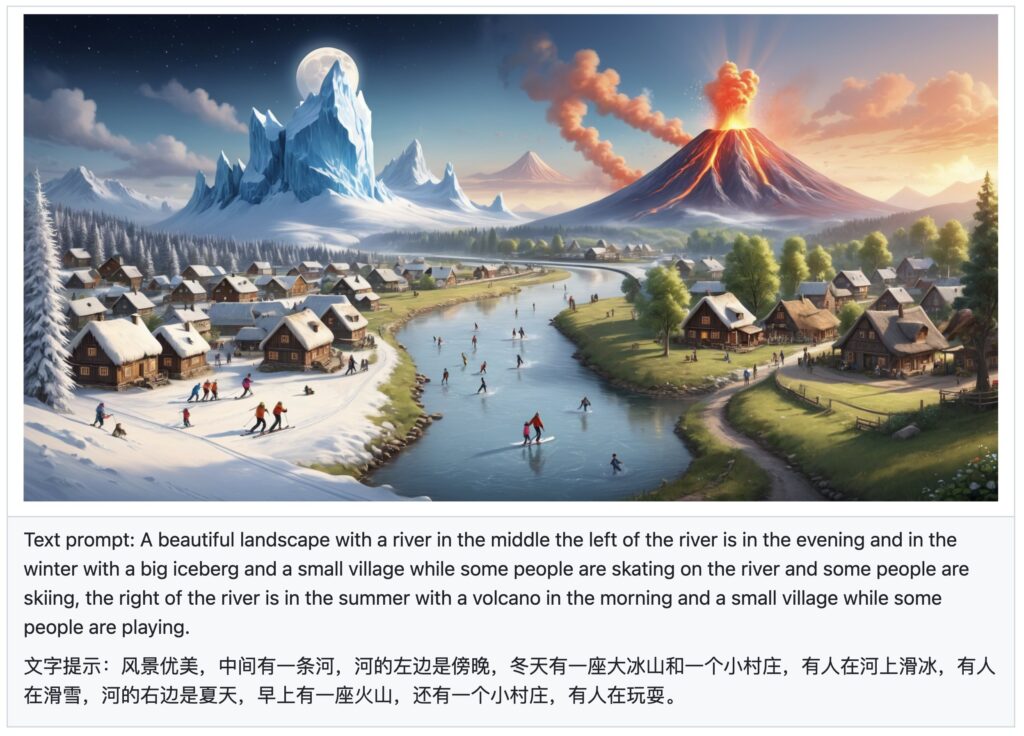

RPG利用大语言模型来更好地理解和分解生成图像的文字提示,把一幅图像分解成不同的部分或区域。

然后对每个部分都根据理解的相应文本提示来生成图像,最后合成为一个符合你预期要求的图像。

该框架无需额外的模型训练,可直接使用。

RPG框架的主要功能:

1、多模态重标记:

将简单的文本提示转换为更具描述性和详细性的提示。

目的是提高生成图像的质量和与文本的语义对齐程度。

2、思维链规划:

将复杂的图像生成任务分解为多个简单的子任务。

在图像空间中划分为互补的子区域,每个子区域对应一个特定的子任务。

3、补充区域扩散:

在非重叠的子区域中独立生成图像内容。

将这些内容合并,创建一幅完整的复合图像。

4、高分辨率图像生成:能够生成超高分辨率的图像。

5、多样化应用:支持多种扩散模型,包括SDXL和SD v1.4/1.5等,兼容不同的MLLM架构。这使得RPG在复杂图像生成和精确图像编辑方面具有更高的灵活性和准确性。

6、RPG-DiffusionMaster不仅支持专有的大语言模型,如GPT-4、Gemini PRO等,还支持开源模型,如miniGPT-4,提供了更广泛的应用可能性。

由于使用先进的大型语言模型,该框架可以直接应用于文本到图像的转换任务,无需进行额外的模型训练。

举例解释:

比如,你的提示词是:“我想要一幅画,画里有一只大象在草地上玩足球。”

RPG框架是怎么工作的呢?

1、多模态重标记:RPG框架通过多模态重标记将您的描述变得更加详细和具体。这不仅包括询问更多细节(如大象的颜色、草地的状态、天气情况等),还涉及对文本提示进行深入的分析和理解,以便更准确地捕捉要生成的图像的细节。

比如,它会问:“这只大象是什么颜色的?草地是绿色的还是黄色的?是晴天还是阴天?”这样,它就能更好地理解你的想法。

2、思维链规划:RPG框架利用思维链规划将图像分解为多个部分。它会根据描述中的不同元素(如大象、草地、天空)规划出图像的各个区域,并分别处理这些区域,确保每个部分都符合描述且相互协调。

例如:它会把这幅画分成几个部分来画。先画大象,再画草地,最后画天空。这样一步一步来,可以确保每个部分都画得很好,而且互不干扰。

3、合并成一幅完整的画(补充区域扩散):最后,通过补充区域扩散,将这些单独绘制的部分合并成一幅完整的画。这一步骤确保最终图像的每个部分都无缝融合,形成一个统一且与描述高度一致的完整场景。

实验结果:

1、高度准确的图像生成:RPG框架能够根据复杂的文本描述生成高度准确和详细的图像。它在处理包含多个对象、属性和关系的场景时表现出色,生成的图像与文本描述高度一致。

2、优于现有技术:与现有的文本到图像模型(如DALL-E 3和SDXL)相比,RPG框架展现了更好的性能。特别是在处理多元素组合和文本-图像语义对齐方面,RPG框架显示出显著的优势。

3、灵活性和广泛的适用性:实验表明,RPG框架能够与不同的多模态大型语言模型(如GPT-4)和扩散模型(如ControlNet)兼容。这使得RPG框架能够应用于多种不同的图像生成场景。

4、质量和细节的提升:生成的图像不仅在视觉上吸引人,而且细节丰富,这对于艺术创作、设计和娱乐等领域尤为重要。RPG框架还能够处理复杂的交互和环境,生成的图像在构图和细节方面都表现优秀。

RPG框架的实验结果表明,它是一个强大且灵活的工具,能够将复杂的文本描述转化为高质量的图像,适用于广泛的应用场景。

GitHub:https://github.com/YangLing0818/RPG-DiffusionMaster

论文:https://arxiv.org/abs/2401.11708